Der wachsende Widerstand gegen Microsofts aggressive Strategie zur Integration künstlicher Intelligenz in Windows 11 hat eine neue, besorgniserregende Dimension erreicht, die sich in der Entwicklung radikaler Werkzeuge von Drittanbietern manifestiert. Ein solches auf der Entwicklerplattform GitHub aufgetauchtes Tool namens „Remove Windows AI“ verspricht Anwendern eine vollständige Befreiung von den als aufgezwungen empfundenen KI-Funktionen, doch dieses Versprechen ist mit erheblichen und potenziell irreversiblen Gefahren für die Stabilität und Sicherheit des Systems verbunden. Dieser schwelende Konflikt zwischen dem verständlichen Wunsch der Nutzer nach Kontrolle über den eigenen Computer und der unnachgiebigen Vision des Softwarekonzerns wirft grundsätzliche Fragen zur Zukunft des Betriebssystems auf. Er verdeutlicht eine tiefe Kluft zwischen den Entwicklern in Redmond und einem signifikanten Teil ihrer Kundschaft, der sich zunehmend bevormundet fühlt und nach Wegen sucht, die Kontrolle zurückzugewinnen, selbst wenn dies bedeutet, riskante Pfade zu beschreiten.

Das Werkzeug „Remove Windows AI“: Funktionsweise und Gefahren

Ein Radikaler Eingriff in das System

Das von einem Entwickler unter dem Pseudonym „Zoicware“ veröffentlichte PowerShell-Skript „Remove Windows AI“ verfolgt einen kompromisslosen und tiefgreifenden Ansatz, der weit über die üblichen Anpassungen durch die Windows-Registry oder Gruppenrichtlinien hinausgeht. Anstatt KI-Funktionen wie den Copilot lediglich zu deaktivieren, was oft nur eine vorübergehende oder oberflächliche Lösung darstellt, greift dieses Werkzeug zu einer drastischeren Methode. Es löscht gezielt ganze Programmpakete, die mit KI-Funktionalitäten in Verbindung stehen, direkt aus den Systemdateien von Windows 11. Dabei handelt es sich um Komponenten, die von Microsoft als fester Bestandteil des Betriebssystems konzipiert und explizit nicht für eine Deinstallation durch den Endanwender vorgesehen sind. Dieser Vorgang ist mit einer chirurgischen Operation am offenen Herzen des Systems vergleichbar, bei der essenzielle Teile entfernt werden, ohne die genauen Auswirkungen auf das Gesamtgefüge vollständig absehen zu können. Die Radikalität dieses Vorgehens spiegelt die Verzweiflung einiger Nutzer wider, die keine andere Möglichkeit mehr sehen, sich der unerwünschten Software zu entledigen.

Um die Effektivität des Eingriffs dauerhaft zu sichern und eine automatische Neuinstallation der entfernten KI-Komponenten durch zukünftige System-Updates zu verhindern, geht das Skript noch einen entscheidenden Schritt weiter. Es implementiert ein modifiziertes Windows-Update-System, das als eine Art Schutzschild gegen nachfolgende KI-Integrationen von Microsoft dienen soll. Diese Manipulation des Update-Mechanismus ist ein besonders heikler Eingriff, da er eine der zentralsten Funktionen des Betriebssystems betrifft, die für die Sicherheit und Stabilität unerlässlich ist. Während erste Berichte, wie sie vom Online-Magazin Tom’s Hardware zitiert werden, darauf hindeuten, dass das Tool seine primäre Aufgabe auf den ersten Blick effektiv erfüllt und die KI-Elemente verschwinden lässt, verschleiert dieser oberflächliche Erfolg die enormen Risiken, die mit einem derart invasiven Vorgehen verbunden sind. Die bewusste Unterbrechung des offiziellen Update-Zyklus kann nicht nur die Integration neuer Features verhindern, sondern auch die Auslieferung kritischer Sicherheits-Patches blockieren.

Gefahr für die Systemstabilität

Die Verwendung von „Remove Windows AI“ erfolgt ausschließlich auf eigene Gefahr und birgt fundamentale Risiken für die Integrität des Betriebssystems, die weit über kleinere Störungen hinausgehen. Der tiefgreifende Eingriff in die Systemarchitektur durch das Löschen von nicht dafür vorgesehenen Komponenten kann unvorhersehbare und schwerwiegende Folgen haben, die sich oft erst nach einiger Zeit bemerkbar machen. Viele andere, für den stabilen Betrieb von Windows essenzielle Funktionen oder vom Nutzer installierte Programme könnten von diesen entfernten KI-Paketen abhängig sein, ohne dass dies auf den ersten Blick ersichtlich ist. Die Folge können permanente Instabilität, unerklärliche Fehlermeldungen, plötzliche Systemabstürze oder der vollständige Funktionsverlust wichtiger Anwendungen sein. Ein solch gewaltsamer Eingriff zerstört die fein abgestimmte Balance des Betriebssystems und hinterlässt eine geschwächte, fehleranfällige Softwareumgebung, deren Verhalten nicht mehr zuverlässig vorhergesagt werden kann. Anwender riskieren, ein funktionierendes System gegen ein unberechenbares auszutauschen.

Im schlimmsten Fall kann die gesamte Windows-Installation durch die Nutzung des Skripts nachhaltig und irreparabel beschädigt werden, sodass eine komplette Neuinstallation des Betriebssystems unumgänglich wird. Dies bedeutet nicht nur einen erheblichen Zeitaufwand, sondern auch den potenziellen Verlust von persönlichen Daten, Einstellungen und installierten Programmen, sofern keine aktuellen Sicherungen vorhanden sind. Die Komplexität moderner Betriebssysteme wie Windows 11 bedeutet, dass unzählige Abhängigkeiten zwischen verschiedenen Modulen und Diensten bestehen. Das Entfernen eines einzelnen, scheinbar isolierten Pakets kann eine unvorhersehbare Kettenreaktion auslösen, die das gesamte System destabilisiert. Die Hoffnung, durch das Tool eine „sauberere“ Version von Windows zu erhalten, kann sich somit schnell ins Gegenteil verkehren und zu einem Zustand führen, der weitaus problematischer ist als die bloße Anwesenheit einer unerwünschten KI-Funktion. Die Risiken stehen in keinem vernünftigen Verhältnis zum angestrebten Nutzen, da der potenzielle Schaden immens ist.

Ein Einfallstor für Schadsoftware

Abgesehen von der Gefahr für die Systemstabilität stellt das Ausführen von Skripten aus unbekannten oder nicht verifizierten Quellen per se eine erhebliche Bedrohung für die Cybersicherheit dar. Ein PowerShell-Skript, das mit Administratorrechten ausgeführt wird, erhält uneingeschränkten Zugriff auf das gesamte System. Es kann Dateien lesen, ändern und löschen, neue Software installieren und die Systemeinstellungen manipulieren. Dies öffnet potenziell ein Einfallstor für jegliche Art von Schadsoftware wie Viren, Trojaner, Spyware oder Ransomware. Selbst wenn der ursprüngliche Entwickler des Tools keine böswilligen Absichten hegt, könnten Dritte das Skript manipulieren und auf verschiedenen Plattformen eine infizierte Version verbreiten. Anwender, die auf der Suche nach einer Lösung für ihr KI-Problem sind, könnten unwissentlich eine Version herunterladen, die im Hintergrund schädliche Aktionen ausführt. Die Natur von Open-Source-Projekten auf Plattformen wie GitHub macht es für Laien schwierig, die Authentizität und Sicherheit des Codes zu überprüfen, wodurch sie sich einem unkalkulierbaren Risiko aussetzen.

Als besonders alarmierendes Signal muss die Anweisung des Entwicklers in der Dokumentation des Tools gewertet werden. In dieser empfiehlt „Zoicware“ den Nutzern ausdrücklich, ihren Antivirenschutz temporär zu deaktivieren, da das Skript angeblich von einigen Sicherheitsprogrammen fälschlicherweise als bösartig erkannt werden könnte. Es wird eindringlich davor gewarnt, diesem Rat zu folgen, da es sich hierbei um eine klassische und wohlbekannte Taktik von Cyberkriminellen handelt, um ihre Schadsoftware unbemerkt auf einem System zu installieren und die Schutzmechanismen zu umgehen. Kein seriöser Entwickler würde Nutzer dazu anhalten, ihre primäre Verteidigungslinie gegen Bedrohungen aus dem Internet abzuschalten. Diese Empfehlung allein sollte ausreichen, um bei jedem verantwortungsbewussten Anwender die Alarmglocken schrillen zu lassen und von der Nutzung des Tools abzusehen. Das Befolgen dieser Anweisung macht den Computer schutzlos und setzt ihn den vielfältigen Gefahren des Internets ohne jegliche Abwehrmaßnahme aus. Das Risiko einer Kompromittierung des Systems steigt dadurch exponentiell an.

Hintergründe des Widerstands: Microsofts Umstrittene KI-Strategie

Die Wachsende Kluft zwischen Nutzer und Konzern

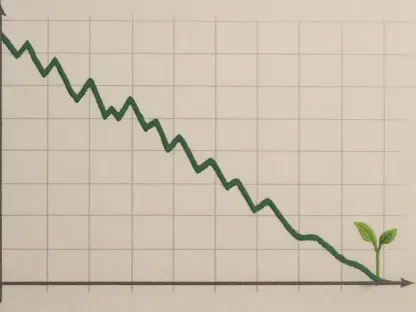

Das Aufkommen von Werkzeugen wie „Remove Windows AI“ ist nicht die Ursache, sondern ein klares Symptom einer tiefgreifenden und wachsenden Unzufriedenheit vieler Nutzer mit der aktuellen Unternehmensstrategie von Microsoft. Viele Anwender fühlen sich vom Kurs des Konzerns bevormundet und kritisieren die aggressive Durchsetzung von KI-Funktionen, die sie weder angefordert haben noch benötigen. Die Hauptkritikpunkte, die in Online-Foren wie Reddit und auf Technologie-Websites immer wieder geäußert werden, umfassen das unnötige Aufblähen des Betriebssystems mit unerwünschten Funktionen, die oft als „Bloatware“ bezeichnet werden. Diese verbrauchen wertvolle Systemressourcen und machen die Benutzeroberfläche unübersichtlicher. Hinzu kommt die Frustration über die mangelnde Möglichkeit, diese Features einfach und vor allem dauerhaft zu deinstallieren. Microsoft erschwert die Entfernung bewusst, was den Eindruck erweckt, dass die Wahlfreiheit der Nutzer systematisch untergraben wird. Dieser Mangel an Kontrolle über das eigene Gerät ist für viele ein zentrales Ärgernis.

Über die Kritik an der Systembelastung und der mangelnden Kontrolle hinaus bestehen erhebliche Bedenken hinsichtlich des Datenschutzes. Die tiefgreifende Integration von künstlicher Intelligenz in das Betriebssystem bedeutet, dass diese Systeme potenziell Zugriff auf persönliche Daten, Arbeitsabläufe, E-Mails und private Dokumente haben. Obwohl Microsoft Transparenz und Sicherheit verspricht, bleibt bei vielen Nutzern ein tiefes Misstrauen bestehen, insbesondere da die genaue Funktionsweise der Datenerhebung und -verarbeitung oft intransparent bleibt. Die Sorge, dass sensible Informationen für das Training von KI-Modellen verwendet oder anderweitig ausgewertet werden könnten, ist weit verbreitet. Diese Kombination aus gefühltem Kontrollverlust, der erzwungenen Nutzung von Ressourcen für unerwünschte Funktionen und gravierenden Datenschutzbedenken schafft ein Klima des Widerstands. In diesem Klima erscheinen selbst riskante Werkzeuge wie „Remove Windows AI“ einigen als legitimes Mittel zur Selbstverteidigung gegen die als übergriffig empfundene Strategie eines Technologiegiganten.

Frühere Kontroversen als Warnsignal

Die anhaltende Kritik an Microsofts aktueller KI-Agenda ist kein neues Phänomen, sondern fügt sich in eine Reihe früherer Vorfälle ein, bei denen der Konzern die Wünsche und Bedenken seiner Nutzerbasis zu ignorieren schien. Ein prägnantes Beispiel war der „Shitstorm“, der auf die Ankündigung folgte, noch mehr Copilot-Funktionen tief in die Microsoft 365 Suite zu integrieren. Die Behauptung des Unternehmens, dies geschehe auf ausdrücklichen Nutzerwunsch hin, wurde in der Community mit Unglauben und Spott aufgenommen, da sie im Widerspruch zu den zahlreichen kritischen Stimmen stand, die bereits zuvor laut geworden waren. Solche Ereignisse nähren den Verdacht, dass Microsoft das Feedback seiner Kunden nur selektiv wahrnimmt und primär seine eigene strategische Vision verfolgt, selbst wenn diese auf breiten Widerstand stößt. Diese wiederholte Missachtung der Community-Stimmung hat zu einem spürbaren Vertrauensverlust geführt und das Image des Unternehmens als Partner seiner Kunden nachhaltig beschädigt, was die Akzeptanz für zukünftige Initiativen von vornherein erschwert.

Ein noch drastischeres Beispiel für die Diskrepanz zwischen Microsofts Entwicklungszielen und den Sicherheitsbedenken der Öffentlichkeit war die Kontroverse um die „Recall“-Funktion. Dieses Werkzeug, das in regelmäßigen Abständen Bildschirmaufnahmen erstellen sollte, um eine durchsuchbare visuelle Historie der Nutzeraktivitäten zu schaffen, löste einen Aufschrei unter Sicherheitsexperten und Datenschützern aus. Die potenziellen Risiken, dass diese sensiblen Daten in die falschen Hände geraten könnten, waren so groß, dass sie sogar die britischen Datenschutzbehörden auf den Plan riefen. Der immense öffentliche Druck zwang Microsoft schließlich zu einer öffentlichen Kurskorrektur und einer grundlegenden Überarbeitung der Funktion, noch bevor sie breit ausgerollt wurde. Obwohl das Unternehmen letztendlich reagierte, hatte der Vorfall bereits einen erheblichen Imageschaden verursacht. Er diente als eindringliche Mahnung, wie schnell ambitionierte technologische Visionen mit den fundamentalen Bedürfnissen der Nutzer nach Sicherheit und Privatsphäre kollidieren können, wenn diese nicht von Anfang an im Mittelpunkt der Entwicklung stehen.

Ein Appell für mehr Wahlfreiheit

Zusammenfassend zeigte sich eine tiefe Kluft zwischen Microsofts Vision einer vollständig KI-gesteuerten Zukunft und den Wünschen eines signifikanten Teils seiner Nutzerbasis. Die Prognosen deuteten darauf hin, dass der Konzern seinen Kurs beibehalten würde, ähnlich wie er es bei den umstrittenen Hardware-Anforderungen für Windows 11 getan hatte. Die zentrale Erkenntnis war jedoch, dass der Zwang zur Nutzung von künstlicher Intelligenz kontraproduktiv wirkte. Anstatt die Anwender vom potenziellen Mehrwert der neuen Technologien zu überzeugen, schürte dieser Ansatz Misstrauen und trieb verzweifelte Menschen zu gefährlichen Notlösungen wie „Remove Windows AI“. Es wurde klar, dass Microsoft gut daran getan hätte, stärker auf das Feedback seiner Nutzer zu hören und echte Wahlfreiheit zu gewähren. Andernfalls würde die Nachfrage nach radikalen Entfernungstools weiter wachsen und ein gefährliches Umfeld schaffen, das Cyberkriminelle für ihre Zwecke ausnutzen könnten. Die Debatte machte deutlich, dass Innovation nur dann erfolgreich sein konnte, wenn sie den Nutzer nicht bevormundete, sondern ihn befähigte.