Die Künstliche Intelligenz, kurz KI, hat in den letzten Jahren in vielen Bereichen Einzug gehalten, und die Personalauswahl bildet hier keine Ausnahme – doch wie viel Wahrheit steckt hinter den vollmundigen Versprechungen der Softwareanbieter? In einer Zeit, in der Unternehmen unter Druck stehen, effizienter zu arbeiten und gleichzeitig die besten Talente zu gewinnen, wird KI oft als Wundermittel präsentiert, das den Rekrutierungsprozess revolutionieren soll. Doch kritische Stimmen, wie die von Prof. Dr. Uwe P. Kanning, einem Experten für Wirtschaftspsychologie, mahnen zur Vorsicht. Es wird hinterfragt, ob die Technologie tatsächlich die objektiven und fundierten Entscheidungen ermöglicht, die sie verspricht, oder ob die Realität hinter den Erwartungen zurückbleibt. Dieser Artikel beleuchtet die zentralen Aspekte dieser Debatte, von den technischen Möglichkeiten über die wissenschaftliche Fundierung bis hin zur Wahrnehmung durch Bewerberinnen und Bewerber, und zeigt auf, wo die Grenzen der Technologie liegen.

Kritische Analyse der Versprechen von Softwareanbietern

Unrealistische Behauptungen und Validitätsprobleme

Die Versprechen der Softwareanbieter, mit Künstlicher Intelligenz aus simplen Bewerbungsunterlagen wie Anschreiben detaillierte Persönlichkeitsprofile zu erstellen, klingen auf den ersten Blick beeindruckend, doch bei genauerer Betrachtung zeigen sich erhebliche Schwächen. Ein gravierendes Problem liegt darin, dass viele Bewerbungsunterlagen heute nicht mehr von den Bewerberinnen und Bewerbern selbst verfasst werden, sondern ebenfalls mithilfe von Künstlicher Intelligenz generiert sind. Dies wirft die Frage auf, wie zuverlässig eine Analyse sein kann, wenn die Grundlage möglicherweise nicht authentisch ist. Die Softwareanbieter werben mit einer Präzision, die in der Praxis oft nicht nachvollziehbar ist. Kritiker bemängeln, dass solche Analysen eher oberflächlich bleiben und keine tiefgehenden Rückschlüsse auf die tatsächliche Eignung einer Person zulassen. Die Gefahr besteht, dass Unternehmen aufgrund solcher fragwürdiger Daten Entscheidungen treffen, die weder fair noch fundiert sind.

Ein weiterer Punkt der Kritik betrifft die Fähigkeit von KI, Aspekte wie Sprache oder Körpersprache in Einstellungsgesprächen zu deuten. Softwareanbieter behaupten, dass ihre Werkzeuge in der Lage seien, Persönlichkeitsmerkmale aus der Kommunikation abzuleiten, doch Experten wie Prof. Kanning halten dies für übertrieben. Zwar spiegeln sich in der Art und Weise, wie Menschen sprechen oder sich präsentieren, gewisse Eigenschaften wider, aber dies reicht bei Weitem nicht aus, um belastbare Urteile über die berufliche Eignung zu fällen. Die Komplexität menschlichen Verhaltens lässt sich nicht so einfach in Algorithmen abbilden. Hinzu kommt, dass solche Analysen oft kulturelle oder individuelle Unterschiede außer Acht lassen, was zu Verzerrungen führen kann. Unternehmen riskieren somit, auf Technologien zu setzen, die mehr Schein als Sein bieten, und könnten dadurch wertvolle Talente übersehen.

Ethische Bedenken bei automatisierten Analysen

Neben den technischen Schwächen rücken auch ethische Fragen in den Fokus, wenn es um den Einsatz von künstlicher Intelligenz in der Personalauswahl geht, da die Automatisierung von Auswahlprozessen bei Bewerberinnen und Bewerbern schnell das Gefühl hervorrufen kann, entpersonalisiert zu werden. Der menschliche Faktor tritt dabei in den Hintergrund. Wenn eine Software über die Eignung entscheidet, ohne dass ein persönlicher Kontakt stattfindet, entsteht schnell der Eindruck, dass die individuelle Geschichte und Persönlichkeit einer Person keine Rolle spielen. Dies könnte das Vertrauen in den potenziellen Arbeitgeber nachhaltig beeinträchtigen. Zudem bleibt oft unklar, nach welchen Kriterien die Algorithmen urteilen, was die Transparenz des Verfahrens in Frage stellt und Bedenken hinsichtlich der Fairness weckt.

Ein weiteres ethisches Problem ist die potenzielle Verzerrung in den Algorithmen selbst, die bei der Entwicklung von Künstlicher Intelligenz (KI) auftreten kann. Wenn die zugrunde liegenden Daten, auf denen die KI trainiert wurde, bereits Vorurteile enthalten, besteht die Gefahr, dass diese Vorurteile in die Auswahlentscheidungen einfließen und zu unfairen Ergebnissen führen. Dies könnte bestimmte Gruppen benachteiligen und bestehende Ungleichheiten verstärken. Solche Risiken sind besonders problematisch in einem Bereich wie der Personalauswahl, wo Fairness und Chancengleichheit oberste Priorität haben sollten. Die Softwareanbieter stehen daher in der Pflicht, nicht nur die technische Funktionalität ihrer Produkte zu gewährleisten, sondern auch sicherzustellen, dass ethische Standards eingehalten werden. Ohne klare Richtlinien und Kontrollmechanismen könnte der Einsatz von KI mehr Schaden als Nutzen bringen.

Wissenschaftliche Fundierung und Prognosekraft

Mangel an empirischen Belegen

Die wissenschaftliche Grundlage von KI-gestützten Verfahren in der Personalauswahl steht unter starker Kritik, da es an überzeugenden empirischen Belegen für deren Wirksamkeit fehlt. Viele der angepriesenen Methoden basieren weniger auf fundierter Forschung als auf den Marketingstrategien der Softwareanbieter, was die Glaubwürdigkeit solcher Ansätze infrage stellt. Experten betonen, dass die Prognosekraft solcher Tools, also die Fähigkeit, die berufliche Leistung einer Person zuverlässig vorherzusagen, bislang nicht ausreichend nachgewiesen ist. Die Praxis zeigt, dass Unternehmen oft auf Technologien setzen, ohne deren tatsächlichen Nutzen kritisch zu hinterfragen. Dies führt zu einer Diskrepanz zwischen den hohen Erwartungen und der realen Leistungsfähigkeit der Systeme, was letztlich sowohl Zeit als auch Ressourcen verschwendet.

Darüber hinaus wird bemängelt, dass die Entwicklung und Anwendung von Künstlicher Intelligenz (KI) in diesem Bereich selten mit den Erkenntnissen der Wirtschaftspsychologie oder anderer relevanter Disziplinen abgestimmt ist. Eine stärkere Orientierung an wissenschaftlichen Standards könnte dazu beitragen, realistischere und effektivere Ansätze zu entwickeln. Derzeit besteht die Gefahr, dass Unternehmen auf Systeme vertrauen, die zwar modern erscheinen, aber keine verlässlichen Ergebnisse liefern. Die Forderung nach mehr Transparenz und unabhängigen Studien zur Validität solcher Verfahren wird daher immer lauter. Nur durch eine enge Verbindung von Forschung und Praxis lässt sich sicherstellen, dass KI in der Personalauswahl nicht nur ein modisches Schlagwort bleibt, sondern einen echten Mehrwert bietet.

Notwendigkeit einer forschungsbasierten Herangehensweise

Um die Wirksamkeit von KI in der Personalauswahl zu verbessern, ist eine stärkere Verankerung in der Forschung unerlässlich, da viele Werkzeuge derzeit ohne ausreichende Prüfung ihrer Zuverlässigkeit auf den Markt gebracht werden. Dies ist sowohl für Unternehmen als auch für Bewerberinnen und Bewerber problematisch. Eine fundierte wissenschaftliche Untersuchung könnte aufzeigen, unter welchen Bedingungen KI tatsächlich sinnvoll eingesetzt werden kann und wo ihre Grenzen liegen. Dies würde helfen, realistische Erwartungen zu formulieren und den Fokus auf jene Anwendungsbereiche zu legen, in denen die Technologie nachweislich Vorteile bringt. Ohne diesen Ansatz bleibt die Gefahr bestehen, dass Unternehmen in Technologien investieren, die ihren Zweck nicht erfüllen.

Ein weiterer Aspekt, der mehr Aufmerksamkeit erfordert, ist die langfristige Evaluation solcher Systeme, denn es reicht nicht aus, KI-Tools nur kurzfristig zu testen. Vielmehr müssen deren Auswirkungen auf die Qualität der Einstellungen über einen längeren Zeitraum beobachtet werden. Nur so lässt sich beurteilen, ob die getroffenen Entscheidungen tatsächlich zu einer besseren Passung zwischen Unternehmen und Mitarbeitenden führen. Die Zusammenarbeit zwischen Softwareentwicklern, Wissenschaftlerinnen und Wissenschaftlern sowie Personalabteilungen könnte hierbei eine Schlüsselrolle spielen. Gemeinsam könnten sie Standards entwickeln, die sicherstellen, dass der Einsatz von KI nicht nur innovativ, sondern auch verantwortungsvoll und nachhaltig ist.

Wahrnehmung und Akzeptanz durch Bewerberinnen und Bewerber

Negative Bewertung trotz Innovationsimage

Die Wahrnehmung von Künstlicher Intelligenz (KI) in der Personalauswahl durch Bewerberinnen und Bewerber fällt in vielen Bereichen negativ aus, obwohl die Technologie häufig als innovativ angesehen wird. Studien zeigen, dass Arbeitgeber, die auf automatisierte Verfahren setzen, in Bezug auf ihre Attraktivität oft schlechter abschneiden als jene, die traditionelle Methoden wie persönliche Einstellungsgespräche bevorzugen. Der Grund liegt darin, dass Bewerberinnen und Bewerber den Eindruck gewinnen, nicht als Individuen wahrgenommen zu werden, sondern lediglich als Datenpunkte in einem Algorithmus. Dieses Gefühl der Entpersonalisierung wirkt sich negativ auf die Bereitschaft aus, sich bei einem solchen Unternehmen zu bewerben, und kann langfristig das Vertrauen in die Fairness des Auswahlprozesses untergraben.

Ein weiterer Kritikpunkt ist die ethische Bewertung solcher Verfahren, da viele Bewerberinnen und Bewerber es als fragwürdig empfinden, wenn eine Maschine über ihre Eignung entscheidet, ohne dass menschliche Urteilsfähigkeit oder Empathie eine Rolle spielen. Die Sorge, dass persönliche Umstände oder besondere Qualifikationen übersehen werden könnten, ist weit verbreitet und beeinflusst das Vertrauen in solche Systeme negativ. Zudem fehlt oft die Transparenz darüber, wie die Entscheidungen der KI zustande kommen, was zusätzlich Misstrauen schürt. Im Vergleich dazu werden klassische Verfahren, bei denen ein direkter Austausch mit Personalverantwortlichen stattfindet, als vertrauenswürdiger und gerechter wahrgenommen. Unternehmen müssen daher abwägen, ob der Einsatz von KI den potenziellen Nutzen rechtfertigt, wenn er gleichzeitig das Image schädigen könnte.

Auswirkungen im Kontext des Fachkräftemangels

In Zeiten des Fachkräftemangels gewinnt die Akzeptanz von Auswahlverfahren durch Bewerberinnen und Bewerber eine besondere Bedeutung, da Arbeitgeber zunehmend darauf angewiesen sind, ein positives Image zu pflegen und attraktiv zu wirken. Der Einsatz von KI kann hier kontraproduktiv wirken, wenn er als unpersönlich oder wenig vertrauenswürdig empfunden wird. Gerade im Wettbewerb um die besten Talente ist es entscheidend, dass Unternehmen nicht nur effiziente, sondern auch sympathische und transparente Prozesse bieten. Wenn Bewerberinnen und Bewerber den Eindruck gewinnen, dass ihre Bewerbung lediglich von einer Software gesichtet wird, könnte dies abschreckend wirken und dazu führen, dass sie sich für andere Arbeitgeber entscheiden.

Darüber hinaus verschärft der Fachkräftemangel den Druck auf Unternehmen, ihre Rekrutierungsstrategien anzupassen, um im Wettbewerb um Talente bestehen zu können. Die Balance zwischen technologischer Innovation und menschlicher Interaktion wird dabei zu einer zentralen Herausforderung. Während künstliche Intelligenz (KI) theoretisch helfen könnte, große Mengen an Bewerbungen schneller zu verarbeiten, darf dies nicht auf Kosten der persönlichen Ansprache gehen. Studien deuten darauf hin, dass Bewerberinnen und Bewerber besonders in sensiblen Phasen wie der Jobsuche Wert auf Authentizität und Wertschätzung legen. Unternehmen sollten daher überlegen, wie sie KI als unterstützendes Werkzeug einsetzen können, ohne den menschlichen Kontakt vollständig zu ersetzen, um ihre Attraktivität als Arbeitgeber zu erhalten.

Herausforderungen und Trends

Diskrepanz zwischen Erwartung und Realität

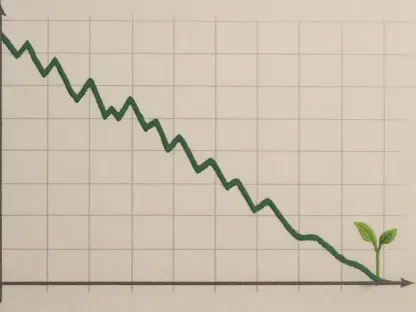

Ein übergeordneter Trend in der Debatte um KI in der Personalauswahl ist die deutliche Diskrepanz zwischen den hochgesteckten Erwartungen und der tatsächlichen Leistungsfähigkeit der Technologie, die oft als universelle Lösung dargestellt wird. Softwareanbieter präsentieren ihre Produkte häufig als Allheilmittel, das den gesamten Rekrutierungsprozess optimieren könne, doch die Realität sieht anders aus. Die Validität und der praktische Nutzen solcher Verfahren sind bislang nicht ausreichend belegt, was bei Unternehmen zu Enttäuschungen führt. Diese Diskrepanz beeinflusst nicht nur die Effizienz der Personalauswahl, sondern auch die langfristige Fähigkeit von Unternehmen, qualifizierte Fachkräfte zu gewinnen, da Fehlinvestitionen in ineffektive Technologien Ressourcen binden, die anderweitig sinnvoller genutzt werden könnten.

Ein weiterer Aspekt dieses Trends ist die Notwendigkeit, realistischere Erwartungen an Künstliche Intelligenz (KI) zu formulieren. Statt die Technologie als alleinige Lösung zu betrachten, sollte sie als unterstützendes Instrument gesehen werden, das in Kombination mit menschlichem Urteilsvermögen eingesetzt wird. Die Wissenschaft mahnt zur Vorsicht und plädiert für eine stärkere Fokussierung auf empirische Belege, bevor weitreichende Entscheidungen auf Basis solcher Systeme getroffen werden. Nur so lässt sich sicherstellen, dass der Einsatz von KI nicht zu einer Enttäuschung führt, sondern tatsächlich einen Mehrwert für die Personalauswahl schafft. Unternehmen stehen vor der Aufgabe, die Grenzen der Technologie zu erkennen und ihre Strategien entsprechend anzupassen.

Balance zwischen Innovation und Akzeptanz

Die Kombination aus technischen Grenzen und mangelnder Akzeptanz durch Bewerberinnen und Bewerber stellt Unternehmen vor eine zentrale Herausforderung: Wie lassen sich Innovationen nutzen, ohne potenzielle Talente zu vergraulen, und wie kann dabei ein Gleichgewicht gefunden werden, das sowohl Effizienz als auch Menschlichkeit berücksichtigt? Die Antwort liegt in einem ausgewogenen Ansatz, der technologische Möglichkeiten mit den Bedürfnissen der Zielgruppe in Einklang bringt. KI könnte beispielsweise zur Vorauswahl von Bewerbungen eingesetzt werden, während die finalen Entscheidungen weiterhin von Personalverantwortlichen getroffen werden. Auf diese Weise würde die Effizienz gesteigert, ohne den persönlichen Kontakt zu vernachlässigen. Unternehmen müssen sicherstellen, dass ihre Prozesse transparent gestaltet sind, um Vertrauen bei den Bewerberinnen und Bewerbern zu schaffen.

Ein weiterer wichtiger Schritt ist die Kommunikation über den Einsatz von künstlicher Intelligenz (KI). Wenn Bewerberinnen und Bewerber verstehen, wie und warum die Technologie genutzt wird, sind sie eher bereit, diese zu akzeptieren. Gleichzeitig sollten Unternehmen darauf achten, dass die menschliche Komponente im Rekrutierungsprozess erhalten bleibt, insbesondere in sensiblen Phasen wie dem ersten Gespräch. Die Zukunft der Personalauswahl könnte in einer hybriden Strategie liegen, die das Beste aus beiden Welten vereint: die Effizienz von KI und die Empathie menschlicher Interaktion. Nur so lässt sich gewährleisten, dass Innovationen nicht zum Selbstzweck werden, sondern tatsächlich dazu beitragen, die besten Talente zu finden und langfristig zu binden.

Zukunftsperspektiven für eine verantwortungsvolle Nutzung

Die kritische Auseinandersetzung mit dem Einsatz von künstlicher Intelligenz (KI) in der Personalauswahl hat in den vergangenen Jahren gezeigt, dass es erheblicher Anstrengungen bedurfte, um die Diskrepanz zwischen den Versprechen der Softwareanbieter und der tatsächlichen Leistungsfähigkeit der Technologie zu überbrücken. Die Diskussion verdeutlichte, dass ohne eine stärkere Orientierung an wissenschaftlichen Erkenntnissen und ohne Berücksichtigung der Bedürfnisse von Bewerberinnen und Bewerbern kein nachhaltiger Fortschritt erzielt werden konnte. Für die kommenden Jahre bleibt es entscheidend, dass Unternehmen verantwortungsvoll mit der Technologie umgehen. Der Fokus sollte darauf liegen, KI als unterstützendes Werkzeug zu etablieren, das menschliche Entscheidungen ergänzt, anstatt sie zu ersetzen. Transparenz und ethische Standards müssen dabei im Vordergrund stehen, um das Vertrauen der Zielgruppe zu gewinnen. Langfristig könnte eine enge Zusammenarbeit zwischen Forschung, Unternehmen und Softwareentwicklern dazu beitragen, realistische und akzeptierte Lösungen zu entwickeln, die sowohl effizient als auch fair sind.